Alive 1.0:

我先把状态变化翻成三款动态壁纸

我先从人车信号里挑出最适合前台表达的变化,做了三款 Alive 1.0 壁纸:生长花把导航与能量流动翻成花朵开合,速度线把车速与转向翻成视觉动势,宠物把档位变化翻成陪伴对象的状态切换。

在 Alive 壁纸、文字壁纸、微光插件与入口重构中,定义 AI 介入的价值、限制与系统承接方式。

从静态壁纸到 Alive 系列,从用户主动设置到系统自动响应 —— 这是这个项目里我重新梳理过的表达介质全貌。卡片中带颜色高亮的标签,是作品集里展开讲过的模块。

我先从人车信号里挑出最适合前台表达的变化,做了三款 Alive 1.0 壁纸:生长花把导航与能量流动翻成花朵开合,速度线把车速与转向翻成视觉动势,宠物把档位变化翻成陪伴对象的状态切换。

1.0 上线后,我去杭州湾实地做可用性测试访谈,确认动态表达到底成立了多少,下一步往哪里推进。

2.0 不是更复杂的 1.0,是更深的 1.0 —— 感知输入扩展到 人 · 车 · 场景三层,意象承接做得更细。

每一次操控都有对应的视觉共鸣 —— 驾驶状态不再只是数据,而是可被感知的动态表达。

从单一"电量 → 开合",延伸到环境 × 能耗 × 充电 × 陪伴的完整能量叙事。

当前已上线 1.0 版本(随档位切换状态),下方 6 个场景是我从用户访谈延展的 2.0 构想。——把会动的壁纸做成有感知、有记忆、会回应你的陪伴对象,从单点联动走向更完整的场景响应。

我们正在推进 4 种 AI 能力,对应主题里的 4 种表达方向。

14 份样本里最高频的反馈。我把它拆开看到 3 层焦虑——选择、意义、持久度。每一层都让用户停在原地,最后随便打几个字退回默认。

降门槛的第一步不是给一句话,是给一个能认到自己的入口。我把 14 份样本归成 4 类诉求,让 5 类静态内容里 4 类一对一专属对应。

用户输入文字后,AI 润色按钮才出现。AI 不抢主动权 —— 用户先表达,AI 才介入扩写。

我提出实况文字概念——把主题包与车辆环境信号绑定,随 天气、时间、地点 一起变。

一项能力如果只能"用户即时输入即时显示",价值就被锁在每次手动输入里。开放给场景助手,自由度 = 触发条件 × 文字内容,整个能力被打开。

我自主探索了一些 OVERRIDE 彩蛋场景,我设定系统可以在极少数时刻打破规则,蹦出一句你没预期、却会记得很久的话。这个频率我压得极低:越稀有越是惊喜,越频繁越变噪音。

将用户操作与系统生成解耦为并行的两条轨道 —— 用户在前台正常使用,系统在后台静默补齐。

桌面框架不同、插件位置不同、视觉冲突的程度也不同。微光效果(主体插件周围渗出的光晕)不是每种桌面都该开 —— 在干净、稳定、无冲突的视觉条件下才能既成立、又高级。

Aa

MAP

Aa

MAP

Aa

3D DESKTOP

Aa

3D DESKTOP

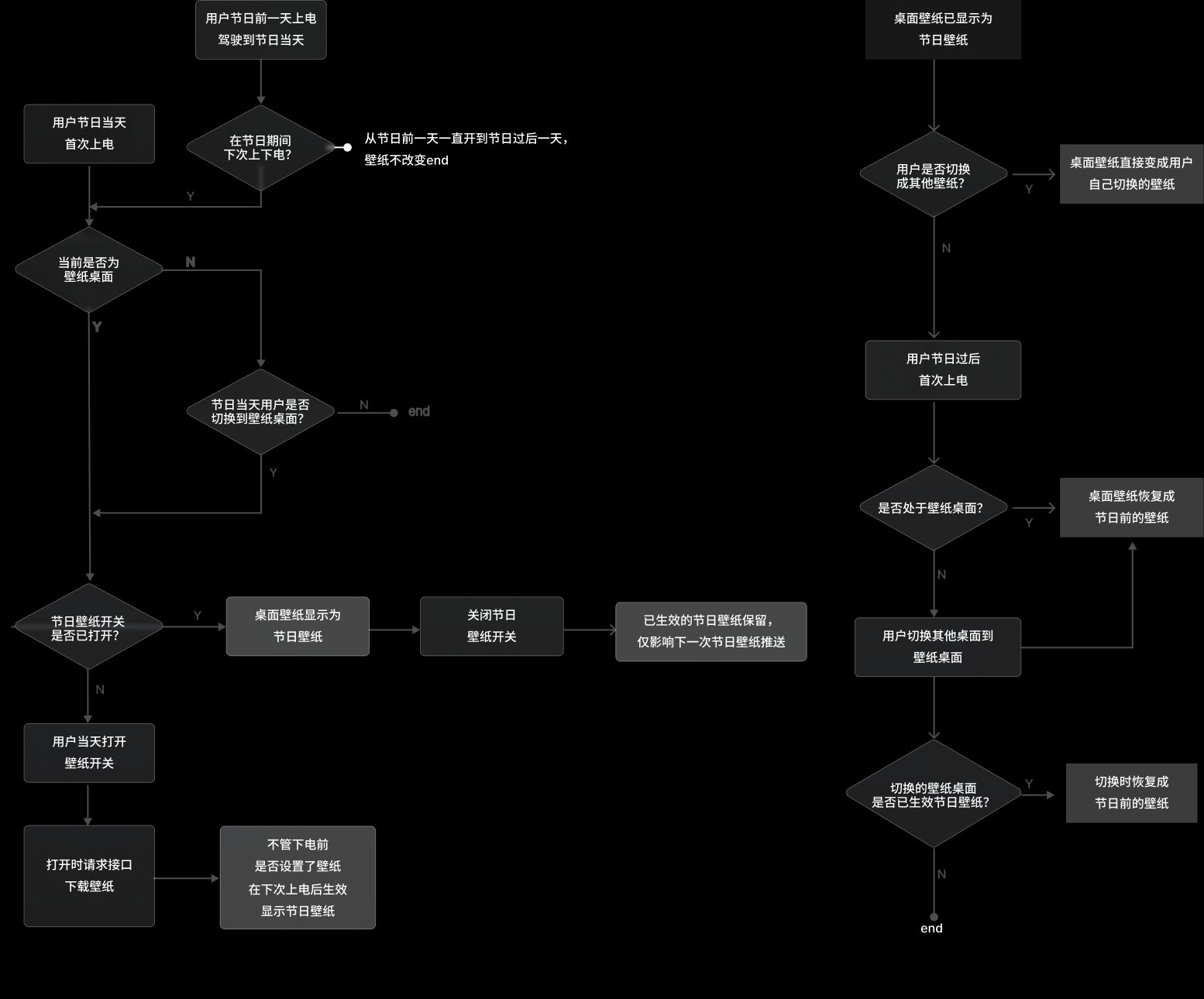

同样是彩蛋,整张壁纸的替换比文字层更难找时机。手机有"息屏 → 亮屏"作为切换节点,车机没有 —— 跨节日 + 三桌面 + 用户行为穿插,什么时候让节日壁纸出现,需要被重新梳理。

能力做出来只是起点 —— 能不能被看见才是终点。从三个具体位置把它们带回用户视野。

这个项目真正的底色。下面是反复出现的四个动作。